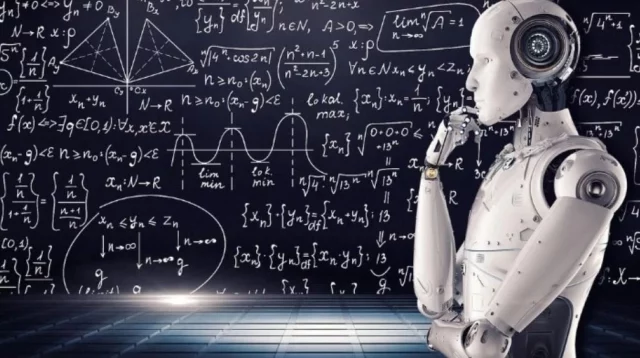

Με την τεχνητή νοημοσύνη (ΑΙ) να αρχίζει πλέον να αποκτά όλο και πιο σημαντικό ρόλο στην καθημερινότητα μας, το ερώτημα που αρχίζει να απασχολεί την ερευνητικό -και όχι μόνο- κοινότητα είναι πόσο «δίκαιες» είναι οι εφαρμογές ΑΙ. Δηλαδή σε τι βαθμό οι απαντήσεις που δίνουν οι διάφοροι ΑΙ «βοηθοί» βασίζονται σε πραγματικά στοιχεία αλλά και πως επηρεάζονται από τις προκαταλήψεις που υπάρχουν.

Το ζήτημα αυτό έχει φέρει στο προσκήνιο ένα νέο ερευνητικό πεδίο, το οποίο αποκαλείται «αλγοριθμική δικαιοσύνη» (algorithmic justice) ή αλλιώς «έλεγχος του ΑΙ» (ΑΙ auditing) όπου αυτό που εξετάζεται είναι κατά πόσο οι αλγόριθμοι που χρησιμοποιούνται από τις εφαρμογές τεχνητής νοημοσύνης δεν κάνουν διακρίσεις. Και αυτό ήταν και το θέμα του ACM FAccT, ενός διεθνούς συνεδρίου με περισσότερους από 600 συμμετέχοντες από πάνω από 39 χώρες που διοργανώθηκε στην Αθήνα την περασμένη εβδομάδα. Το συγκεκριμένο συνέδριο διοργανώνεται από τον ACM, ενός εκ των μεγαλύτερων διεθνών οργανισμών παγκοσμίως στο χώρο των ψηφιακών τεχνολογιών.

«Η περίοδος είναι ιδιαίτερα κρίσιμη καθώς υπάρχουν διαφορετικές απόψεις για το συγκεκριμένο ζήτημα» σημειώνει στο CNN Greece ο Ορέστης Παπακυριακόπουλος, καθηγητής του societal computing (σ.σ. μία από τις ορολογίες που χρησιμοποιούνται στο συγκεκριμένο χώρο) στο Technical University of Munich, προσθέτοντας ότι η επόμενη πενταετία θα καθορίσει πολλές από τις εξελίξεις. «Επιπλέον, θα πρέπει να προσέξουμε ότι αυτές οι τεχνολογίες έχουν μεγάλη κοινωνική επίπτωση. Σκεφτείτε μόνο ότι το 98% των εταιρειών στο Fortune 1000 χρησιμοποιεί ΑΙ συστήματα για τις προσλήψεις που κάνουν» σπεύδει να προσθέσει ο Δαναός Μεταξάς, καθηγητής στο University of Pennsylvania (UPenn), ο οποίος μαζί με τον κ. Παπακυριακόπουλο και την Asia Biega από το Max Planck Institute, ήταν η οργανωτική επιτροπή του ACM FAccT και θεωρούνται εκ των κορυφαίων ερευνητών παγκοσμίως στον τομέα του societal computing.

Ποιο είναι το πρόβλημα

Όπως σημειώνουν οι τρεις ερευνητές, ένα από τα βασικά ζητήματα είναι να εντοπίσεις το πρόβλημα που υπάρχει. Στο ΑΙ βασικό ρόλο παίζουν τα δεδομένα που χρησιμοποιούνται για να εκπαιδευτούν τα μοντέλα αλλά και οι αλγόριθμοι που αναπτύσσονται προκειμένου να «τρέξουν» οι διάφορες εφαρμογές. Αν και εκεί εμφανίζονται διακρίσεις ή υπάρχουν ψεύτικα στοιχεία ή έχουν διαμορφωθεί επίτηδες για να υπάρχουν διακρίσεις, είναι προφανές ότι το ζήτημα είναι αρκετά σημαντικό.

Όμως, υπάρχει μία ακόμη παράμετρος που εμπλέκει τον ανθρώπινο παράγοντα. Σύμφωνα με τους δύο Έλληνες ερευνητές, πολλές φορές το πρόβλημα επιτείνεται από το πως επικοινωνούν τα συστήματα με τους χρήστες. Δηλαδή, επειδή το σύστημα μαθαίνει από την επικοινωνία του με τους χρήστες, αν οι τελευταίοι έχουν προκαταλήψεις, αυτές θα περάσουν και στα συστήματα. Γι’ αυτό και είναι σημαντικό να υπάρχει ο έλεγχος των ΑΙ συστημάτων.

Αντιμετωπίζοντας το πρόβλημα

Από εκεί και πέρα, η συνεχής δοκιμή και ο έλεγχος των αλγοριθμικών μοντέλων είναι μία καλή αρχή, όπως και η θέσπιση ενός κανονιστικού πλαισίου που να θέτει όρια όσον αφορά στη χρήση του ΑΙ. Σημειωτέον πως θεωρούν το ΑΙ Act της Ευρωπαϊκής Ένωσης ως ένα καλό βήμα αλλά θα πρέπει να εξελιχθεί περαιτέρω.

Όμως, ίσως η πιο σημαντική κίνηση να είναι η εκπαίδευση. «Θα πρέπει οι άνθρωποι να εκπαιδευτούν πάνω στο συγκεκριμένο ζήτημα και να καταλάβουν πως λειτουργεί το ΑΙ και να είναι προσεκτικοί όσον αφορά στο πως το χρησιμοποιούν. Όπως και θα πρέπει να δοκιμάζουν διαρκώς τα μοντέλα» σημειώνουν οι κ. Παπακυριακόπουλος και Μεταξάς. «Ακόμη περισσότερο πρέπει να εκπαιδευτούν οι μηχανικοί που αναπτύσσουν αυτά τα συστήματα καθώς σε πολλές περιπτώσεις δεν βλέπουν το πρόβλημα που υπάρχει» σπεύδουν να προσθέσουν οι δύο Έλληνες ερευνητές.

«Το πρόβλημα είναι υπαρκτό, δεν είναι κάτι που θα δούμε και θα πρέπει να το αντιμετωπίσουμε σε συλλογικό επίπεδο» σημειώνουν οι δύο ερευνητές, επισημαίνοντας ότι ο στόχος του ACM FAccT είναι να δημιουργηθεί ένας συνασπισμός των φορέων και οργανισμών που ασχολούνται με το ΑΙ. «Έχουμε εκπροσώπους από διάφορα ιδρύματα από ολόκληρο τον κόσμο» επισημαίνουν οι δύο ερευνητές, σημειώνοντας ότι από την Ελλάδα συμμετείχε ο «Αρχιμήδης», η ερευνητική μονάδα για την τεχνητή νοημοσύνη του Ερευνητικού Κέντρου «Αθηνά».

ΠΗΓΗ: cnn.gr